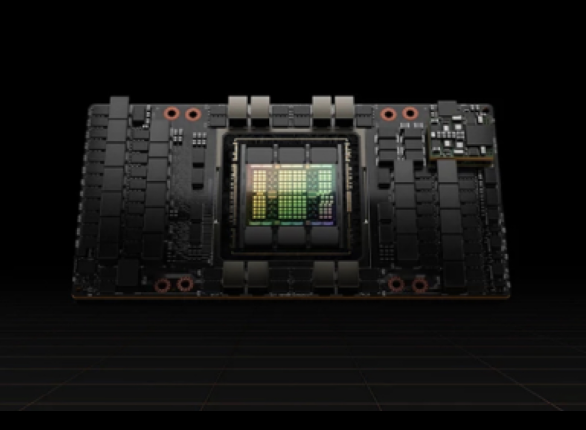

HGX H800

HGX H800

快速、灵活的基础设施以实现最佳性能

基于Kubernetes的云原生平台,您可以享受裸金属的优势,而无需增加基础架构的开销,我们负责处理所有繁重的Kubernetes操作,包括驱动程序管理、控制台扩展,您只需专注于本职工作。

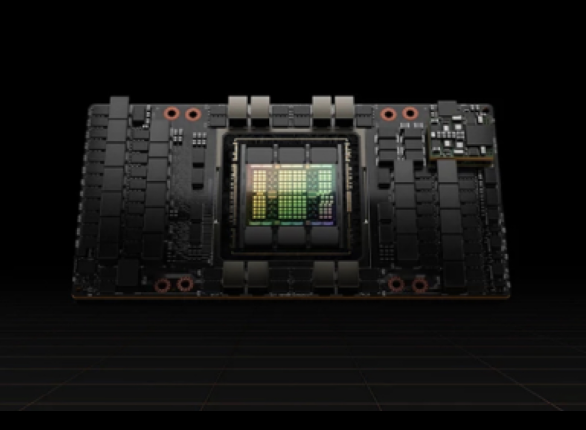

卓越的网络架构,采用NVIDIA InfiniBand

我们的 HGX H800 分布式训练集群采用轨道优化设计,使用 NVIDIA Quantum-2 InfiniBand 网络,支持使用NVIDIA SHARP 进行网络内收集。

轻松迁移现有工作负载

蓝耘针对开箱即用的NVIDIA GPU加速工作负载进行了优化,使您能够轻松地运行现有工作负载,几乎不需要或者只需要进行最小程度的更改。无论您使用SLURM还是容器技术,我们都提供易于部署的解决方案,让您能够在更少的基础设施管理上完成更多的工作。

用于模型训练的HGX H800

先进的分布式训练集群

HGX H800网络性能

HGX H800部署支持

用于推理的HGX H800

HGX H800存储解决方案